お久しぶりです。川野です。

長らくブログを書いていませんでしたが、2/20(火)に東京ビッグサイトで開催された

Microsoft AI Tour に参加してきました。

私はもともとセキュリティに興味があったこともあり、セキュリティ関係のセッションに参加してきました。

セッションは二つあったのですが、そのうちの一つである 『生成AIアプリケーションのセキュリティ保護』について書いていこうと思います。

生成AIの保護に関するセッション

基本的なセキュリティ対策をしていれば、98%の攻撃は防御できると言われています。

これはAIでも当てはまることで、適切なアクセス制限や多要素認証、マルウェア対策などをしっかりしていれば、98%の攻撃は防ぐことができます。

もちろん、アプリケーション自体の対策も必要ですが、生成AIは何かを生成するものですので、生成されたものに関する対策も必要です。

例えば、生成された文章に機密情報が含まれてる可能性もありますので、それらにも適切なアクセス制限をかけてあげる必要もあります。

Microsoftが攻撃者からのリスクに対処している方法

Microsoftがどのように攻撃者からのリスクを対処しているかについても説明がありました。

『マイクロソフトのセキュリティ開発ライフサイクル』+『AI固有の影響評価、脅威モデリング、内部コンプライアンスレビュー』+『オープンソースAIライブラリのセキュリティレビュー』+『AIに特化したレッドチーム編成』をしているとのことです。

では、実際にどのようなリスクがあるのでしょうか。

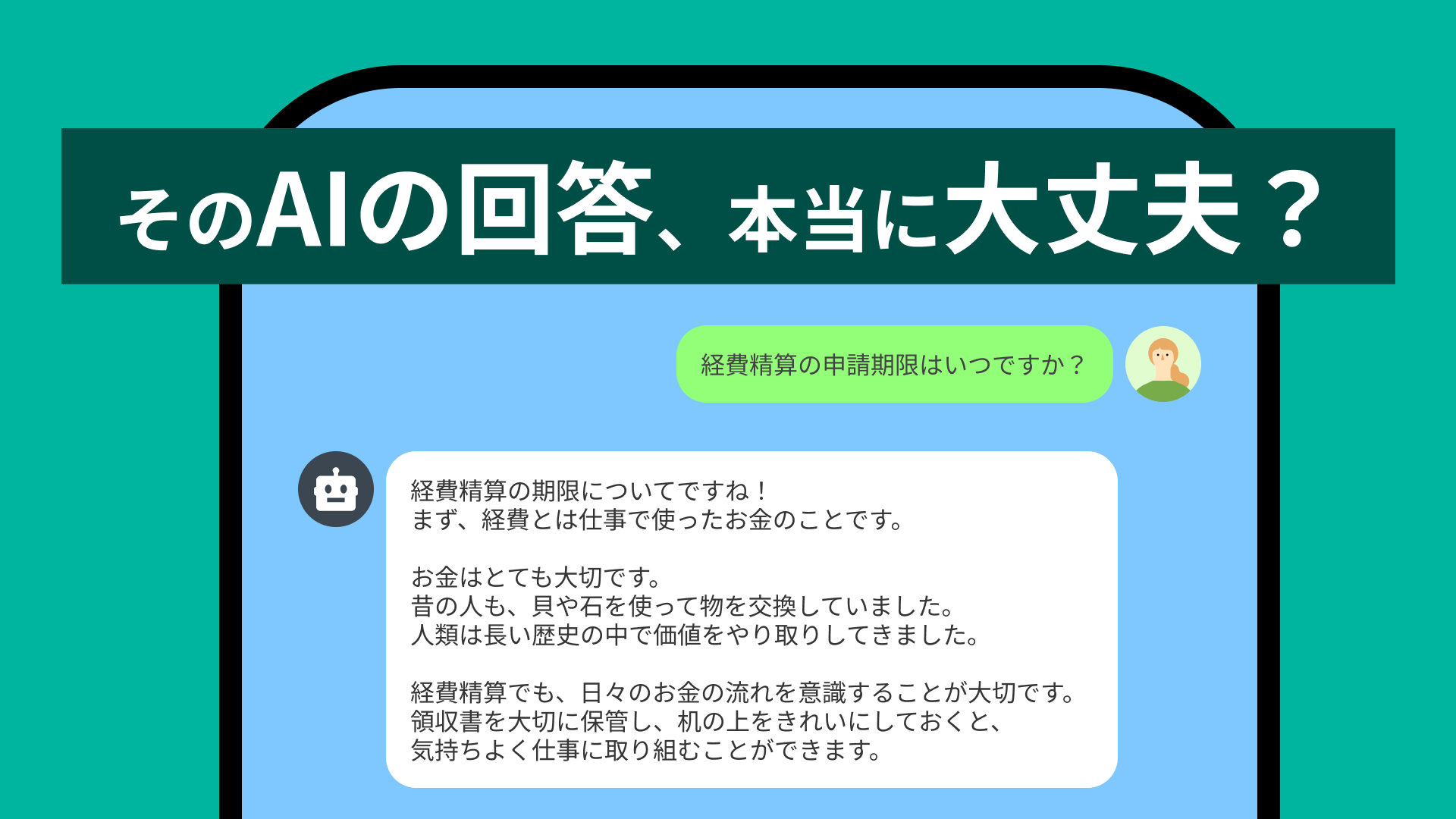

例としては、AIへの過度な依存です。このセッションだけではないですが、『AIはあくまでCopilotであり、MainPilotでもなくAutoPilotではない』と言われていました。これがどういうことかというと、「AIはあくまで副操縦士であるため、人間をサポートするものであり、メイン操縦士でもなく、自動操縦士でもない」ということで、あくまで人間をサポートするものなので、生成されたものをしっかりと人間の目でみて、修正して、正しいものにしてあげる必要があるということです。

「AIが作成したものだからあっている」・「AIが作成したもので合って私が作成したものではない」という考えではなく、「AIに手伝ってもらって私が作成した」となるようにしましょう。

セッションに参加した感想

ここ最近で、生成AIはとても普及し、生活の一部になりつつあると思います。

生成AIは日々進化しているものなので、さらに便利なものになっていくと思います。

もちろん、日々進化していくのなら、それに対する攻撃やリスクも日々進化していきます。

これからも、新たにリスクになるようなことが生まれていないか、現状で対策できているのかをしっかり確認していく必要がありそうですね。

他にも、話の途中で、Microsoft Security Copilotなるものがアーリーアクセスで存在しているという紹介もありました。

こちらも時間を見つけて調査してまた、記事にできたらと思います。

![Microsoft Power BI [実践] 入門 ―― BI初心者でもすぐできる! リアルタイム分析・可視化の手引きとリファレンス](/assets/img/banner-power-bi.c9bd875.png)

![Microsoft Power Apps ローコード開発[実践]入門――ノンプログラマーにやさしいアプリ開発の手引きとリファレンス](/assets/img/banner-powerplatform-2.213ebee.png)

![Microsoft PowerPlatformローコード開発[活用]入門 ――現場で使える業務アプリのレシピ集](/assets/img/banner-powerplatform-1.a01c0c2.png)